ollm:在仅8GB显存的GPU上,利用SSD卸载技术运行超大语言模型(LLM)并支持10万token上下文,无需量化处理。这意味着即使硬件受限,也能处理海量上下文数据。

🔹 速度约为0.5 token/秒,虽不适合实时交互,但适合非实时、离线或后台任务。

🔹 这种做法对SSD寿命有较大影响,需权衡性能与硬件耐用性。

🔹 业内讨论关注点:

- 是否值得牺牲SSD寿命换取超大上下文?

- 未来能否结合新内存扩展技术(如三星CXL DRAM扩展)实现更高效方案?

- 量化与混合硬件策略是否更实用?

这项技术拓宽了超大模型的部署边界,尤其适合资源有限但需要处理海量上下文的场景。未来优化空间巨大,值得持续关注。

当前主流LLM部署受限于显存大小,SSD卸载为“显存瓶颈”提供了新思路,但速度和硬件磨损是现实挑战。结合硬件创新(如CXL内存扩展)与软件优化(量化、分布式推理),未来或能实现高效、耐用的超长上下文推理,为复杂任务提供更强支持。

🔹 速度约为0.5 token/秒,虽不适合实时交互,但适合非实时、离线或后台任务。

🔹 这种做法对SSD寿命有较大影响,需权衡性能与硬件耐用性。

🔹 业内讨论关注点:

- 是否值得牺牲SSD寿命换取超大上下文?

- 未来能否结合新内存扩展技术(如三星CXL DRAM扩展)实现更高效方案?

- 量化与混合硬件策略是否更实用?

这项技术拓宽了超大模型的部署边界,尤其适合资源有限但需要处理海量上下文的场景。未来优化空间巨大,值得持续关注。

当前主流LLM部署受限于显存大小,SSD卸载为“显存瓶颈”提供了新思路,但速度和硬件磨损是现实挑战。结合硬件创新(如CXL内存扩展)与软件优化(量化、分布式推理),未来或能实现高效、耐用的超长上下文推理,为复杂任务提供更强支持。

AI工程不断迭代升级,想掌握LLM、RAG和智能代理的实战技巧?

AI Engineering Hub 是一个集深度教程与实战案例于一体的开源项目,覆盖大语言模型、检索增强生成、AI代理等前沿内容。无论你是入门者、开发者还是研究者,都能在这里找到丰富资源,助力项目落地和技能提升。

主要特色:

- 系统讲解大型语言模型(LLM)和检索增强生成(RAG)技术

- 丰富的AI智能代理实战案例,展示真实业务应用

- 详细示例代码,方便快速上手和二次开发

- 免费数据科学电子书赠送,涵盖150+核心课程,订阅即得

#资源参考 #AI Engineering Hub #LLM #RAG #AI前沿内容

AI Engineering Hub 是一个集深度教程与实战案例于一体的开源项目,覆盖大语言模型、检索增强生成、AI代理等前沿内容。无论你是入门者、开发者还是研究者,都能在这里找到丰富资源,助力项目落地和技能提升。

主要特色:

- 系统讲解大型语言模型(LLM)和检索增强生成(RAG)技术

- 丰富的AI智能代理实战案例,展示真实业务应用

- 详细示例代码,方便快速上手和二次开发

- 免费数据科学电子书赠送,涵盖150+核心课程,订阅即得

#资源参考 #AI Engineering Hub #LLM #RAG #AI前沿内容

系统架构和扩展从来不是只靠理论就能掌握的事情。

《The Accidental CTO》由Subhash Choudhary亲述他如何从零基础到打造支撑百万店铺的Dukaan系统。

这不是枯燥的教科书,而是充满实战经验和幕后故事的系统设计手册:

- 从MVP快速迭代到大规模分布式流水线

- 复制、分片、缓存、队列的利弊权衡

- 观测性、容错设计和云成本管理的实战要点

- 真实生产环境中遇到的各种挑战与解决方案

无论你是工程师、架构师还是创业者,都能从这本书中学到如何将分布式系统从理论变成可用、可扩展、可维护的“活机器”。

#CTO #实践 #MVP

《The Accidental CTO》由Subhash Choudhary亲述他如何从零基础到打造支撑百万店铺的Dukaan系统。

这不是枯燥的教科书,而是充满实战经验和幕后故事的系统设计手册:

- 从MVP快速迭代到大规模分布式流水线

- 复制、分片、缓存、队列的利弊权衡

- 观测性、容错设计和云成本管理的实战要点

- 真实生产环境中遇到的各种挑战与解决方案

无论你是工程师、架构师还是创业者,都能从这本书中学到如何将分布式系统从理论变成可用、可扩展、可维护的“活机器”。

#CTO #实践 #MVP

日常工作、学习和创作中,信息海量且杂乱,如何高效整理和利用上下文成为挑战。

MineContext 是一个开源的主动式上下文感知AI助手,通过截屏和内容理解(未来支持多模态多源信息),实时捕获你的数字世界全貌,自动生成日/周总结、待办事项和活动记录,帮助你理清思路,提升效率。

主要功能:

- 自动截屏,持续捕捉你的数字工作环境,轻松收集海量上下文;

- 智能重现相关内容,创作时快速调取关键资料;

- 主动推送洞见和总结,让信息主动找上你;

- 本地存储,隐私安全有保障;

- 支持多API接入,灵活定制,完美贴合你的需求。

适合知识工作者、内容创作者、项目经理等多种角色。无需频繁切换工具,MineContext让你的数字生活更智能、更高效。

#资源参考 #AI #开源

MineContext 是一个开源的主动式上下文感知AI助手,通过截屏和内容理解(未来支持多模态多源信息),实时捕获你的数字世界全貌,自动生成日/周总结、待办事项和活动记录,帮助你理清思路,提升效率。

主要功能:

- 自动截屏,持续捕捉你的数字工作环境,轻松收集海量上下文;

- 智能重现相关内容,创作时快速调取关键资料;

- 主动推送洞见和总结,让信息主动找上你;

- 本地存储,隐私安全有保障;

- 支持多API接入,灵活定制,完美贴合你的需求。

适合知识工作者、内容创作者、项目经理等多种角色。无需频繁切换工具,MineContext让你的数字生活更智能、更高效。

#资源参考 #AI #开源

开源项目分享:可去除 Gemini 图片右下角可见水印

这是一款一款名为 GeminiWatermarkTool 的命令行开源工具,可离线去除 Gemini 生成图片右下角的可见水印。工具通过反向 Alpha 混合计算,还原被水印覆盖的像素,支持 jpg、png、webp 等常见格式。该工具为由 C++ 编写,无需依赖,并可批量处理目录。作者表示仅针对 Gemini 当前的可见水印,不支持去除隐藏水印。

另有开发者基于此项目开发出纯前端版本,完全在浏览器本地运行,不依赖服务器。项目使用 JavaScript 实现,通过反向 Alpha 混合算法还原原始像素,避免 AI 修补带来的不确定性。

allenk/GeminiWatermarkTool

这是一款一款名为 GeminiWatermarkTool 的命令行开源工具,可离线去除 Gemini 生成图片右下角的可见水印。工具通过反向 Alpha 混合计算,还原被水印覆盖的像素,支持 jpg、png、webp 等常见格式。该工具为由 C++ 编写,无需依赖,并可批量处理目录。作者表示仅针对 Gemini 当前的可见水印,不支持去除隐藏水印。

另有开发者基于此项目开发出纯前端版本,完全在浏览器本地运行,不依赖服务器。项目使用 JavaScript 实现,通过反向 Alpha 混合算法还原原始像素,避免 AI 修补带来的不确定性。

allenk/GeminiWatermarkTool

#文件传输

取文件

在线文件传输工具,不限文件格式,最大支持 10 GB,可选择过期时间和永久有效,上传发送文件后,会给到一个取件码,对方输入即可获取文件,免费使用,无需注册。

https://quwenjian.cc

取文件

在线文件传输工具,不限文件格式,最大支持 10 GB,可选择过期时间和永久有效,上传发送文件后,会给到一个取件码,对方输入即可获取文件,免费使用,无需注册。

https://quwenjian.cc

当贝AI

⭐️ 网站功能:AI助手

📁 网站简介:一个集成了多种优质AI大模型的平台,提供了DeepSeek满血版,聚合了全网的AI资源,如DeepSeek-R1 671B、豆包、通义千问和智谱等。

可以在平台上进行各种AI相关的查询和操作,享受免费的服务,且没有使用限制。

🔗 网站网址:点击打开

⭐️ 网站功能:AI助手

📁 网站简介:一个集成了多种优质AI大模型的平台,提供了DeepSeek满血版,聚合了全网的AI资源,如DeepSeek-R1 671B、豆包、通义千问和智谱等。

可以在平台上进行各种AI相关的查询和操作,享受免费的服务,且没有使用限制。

🔗 网站网址:点击打开

在线智能问答系统,文档上传、向量检索、模型推理一体化,轻松实现本地RAG入门体验。

Local PDF Chat RAG 是一个开源项目,专为想理解并动手实践检索增强生成(RAG)技术的初学者设计。它结合了PDF处理、FAISS向量检索、多模型集成等核心模块,帮助你从源码层面掌握RAG的底层流程。

主要功能:

- 多PDF文档上传与自动文本切割向量化

- 本地FAISS向量数据库构建与高效语义检索

- 混合BM25关键词检索提升召回率

- 交叉编码器及大模型(支持本地 Ollama 和云端 SiliconFlow)结果重排序

- 支持联网搜索增强回答的时效性(需配置SerpAPI密钥)

- 递归式深度检索,自动生成新查询,提升答复深度

- Gradio交互式Web UI,操作简单直观

- 本地化优先,保护数据隐私

适合科研、开发者和RAG技术爱好者快速上手,理解RAG的全流程细节。

#资源参考 #工具 #RAG

Local PDF Chat RAG 是一个开源项目,专为想理解并动手实践检索增强生成(RAG)技术的初学者设计。它结合了PDF处理、FAISS向量检索、多模型集成等核心模块,帮助你从源码层面掌握RAG的底层流程。

主要功能:

- 多PDF文档上传与自动文本切割向量化

- 本地FAISS向量数据库构建与高效语义检索

- 混合BM25关键词检索提升召回率

- 交叉编码器及大模型(支持本地 Ollama 和云端 SiliconFlow)结果重排序

- 支持联网搜索增强回答的时效性(需配置SerpAPI密钥)

- 递归式深度检索,自动生成新查询,提升答复深度

- Gradio交互式Web UI,操作简单直观

- 本地化优先,保护数据隐私

适合科研、开发者和RAG技术爱好者快速上手,理解RAG的全流程细节。

#资源参考 #工具 #RAG

在线寻找音乐资源总是要翻遍各大平台,下载工具、播放器、歌词插件……太多分散工具使用起来很麻烦。

Music Megathread 是一个超全的音乐资源合集,汇集了免费音乐播放器、多平台下载器、流媒体客户端、歌词工具、音乐识别和管理软件,甚至还有Telegram音乐机器人,帮你轻松玩转音乐世界。

不仅支持 Spotify、YouTube Music、Deezer 等主流平台,还覆盖离线播放器、音频编辑、曲库管理、音效合成等丰富功能,满足各种音乐需求。| #音乐

核心亮点:

- 多平台音乐播放器和下载工具,支持Windows、macOS、Linux、Android、iOS;

- 丰富的 Spotify 和 YouTube Music 客户端及辅助工具,解锁更多功能;

- 在线与离线音乐管理、编辑、歌词同步与显示,一站式解决方案;

- 海量音乐识别与元数据编辑工具,方便整理个人音乐库;

- 全面支持音频录制、合成、转换、编辑,适合音乐制作爱好者;

- 集成多种Telegram音乐机器人,聊天中也能轻松找歌听歌。

适合音乐爱好者、音乐制作人、DJ、音频发烧友,帮你更高效地发现、管理和享受音乐。

#音乐资源 #工具 #资源参考

Music Megathread 是一个超全的音乐资源合集,汇集了免费音乐播放器、多平台下载器、流媒体客户端、歌词工具、音乐识别和管理软件,甚至还有Telegram音乐机器人,帮你轻松玩转音乐世界。

不仅支持 Spotify、YouTube Music、Deezer 等主流平台,还覆盖离线播放器、音频编辑、曲库管理、音效合成等丰富功能,满足各种音乐需求。| #音乐

核心亮点:

- 多平台音乐播放器和下载工具,支持Windows、macOS、Linux、Android、iOS;

- 丰富的 Spotify 和 YouTube Music 客户端及辅助工具,解锁更多功能;

- 在线与离线音乐管理、编辑、歌词同步与显示,一站式解决方案;

- 海量音乐识别与元数据编辑工具,方便整理个人音乐库;

- 全面支持音频录制、合成、转换、编辑,适合音乐制作爱好者;

- 集成多种Telegram音乐机器人,聊天中也能轻松找歌听歌。

适合音乐爱好者、音乐制作人、DJ、音频发烧友,帮你更高效地发现、管理和享受音乐。

#音乐资源 #工具 #资源参考

Agentic RAG:AI工程师必知的进阶检索生成框架

简单的RAG(Retrieval-Augmented Generation)系统很少直接用在实际场景。现实中,我们通常会给RAG加上“智能代理”(Agentic)能力,且尽量保持简洁。

没有放之四海皆准的方案,RAG系统必须根据具体业务灵活调整。理解Agentic RAG的关键组成,有助你设计适合自己的方案:

1️⃣ 用户查询分析

- 由基于大模型(LLM)的智能代理分析原始查询,可能重写或拆分成多条查询。

- 判断是否需要额外数据源。

2️⃣ 触发检索

- 若需更多数据,智能代理负责确定应调用哪些数据源,如实时用户数据、内部文档、网络信息等。

3️⃣ 数据整合与重排序

- 用更强的模型对检索结果进行筛选和重排名,大幅缩小信息范围。

4️⃣ 无需额外数据时,直接由LLM生成答案或执行多步动作。

5️⃣ 答案评估与循环优化

- 智能代理评判答案的准确性和相关性。

- 不达标时重新改写查询,重复生成,循环次数有限制。

💡 经验分享:

- 尽量简化流程,很多场景不需全部环节即可满足需求。

- 数据预处理和重排序环节是关键,覆盖90%以上应用。

- Agentic系统远超传统RAG,不只是问答,更能自动执行后续动作,未来会有更多分享,敬请关注!

Agentic RAG的核心在于“智能代理”的灵活决策能力,真正实现从理解用户意图到智能调取数据,再到动态生成和校验答案的全流程闭环。相比传统RAG,Agentic RAG更适合复杂业务场景,尤其是需要自动化执行操作的企业应用。未来AI系统的发展趋势将是“理解+检索+行动”的深度融合,而不仅仅是回答问题。

简单的RAG(Retrieval-Augmented Generation)系统很少直接用在实际场景。现实中,我们通常会给RAG加上“智能代理”(Agentic)能力,且尽量保持简洁。

没有放之四海皆准的方案,RAG系统必须根据具体业务灵活调整。理解Agentic RAG的关键组成,有助你设计适合自己的方案:

1️⃣ 用户查询分析

- 由基于大模型(LLM)的智能代理分析原始查询,可能重写或拆分成多条查询。

- 判断是否需要额外数据源。

2️⃣ 触发检索

- 若需更多数据,智能代理负责确定应调用哪些数据源,如实时用户数据、内部文档、网络信息等。

3️⃣ 数据整合与重排序

- 用更强的模型对检索结果进行筛选和重排名,大幅缩小信息范围。

4️⃣ 无需额外数据时,直接由LLM生成答案或执行多步动作。

5️⃣ 答案评估与循环优化

- 智能代理评判答案的准确性和相关性。

- 不达标时重新改写查询,重复生成,循环次数有限制。

💡 经验分享:

- 尽量简化流程,很多场景不需全部环节即可满足需求。

- 数据预处理和重排序环节是关键,覆盖90%以上应用。

- Agentic系统远超传统RAG,不只是问答,更能自动执行后续动作,未来会有更多分享,敬请关注!

Agentic RAG的核心在于“智能代理”的灵活决策能力,真正实现从理解用户意图到智能调取数据,再到动态生成和校验答案的全流程闭环。相比传统RAG,Agentic RAG更适合复杂业务场景,尤其是需要自动化执行操作的企业应用。未来AI系统的发展趋势将是“理解+检索+行动”的深度融合,而不仅仅是回答问题。

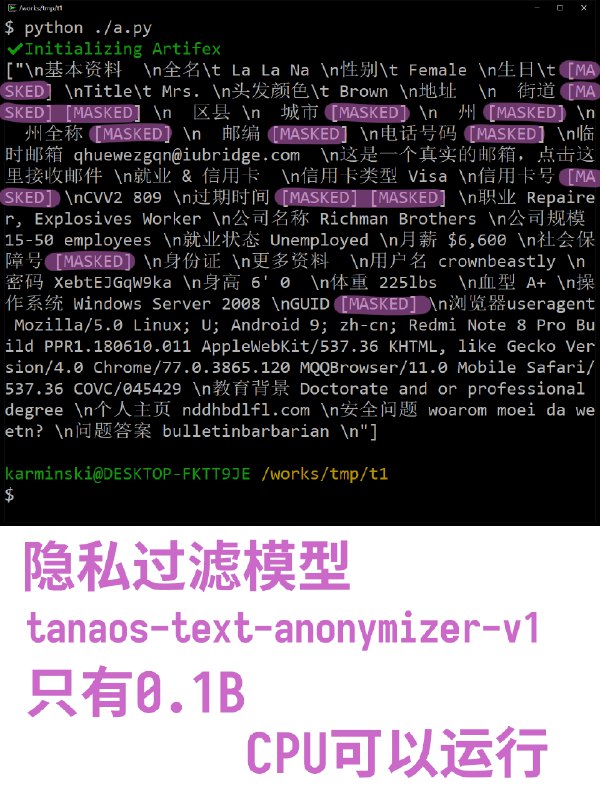

一个体积只有 0.1B、可以在 CPU 上运行的隐私文本过滤模型 tanaos-text-anonymizer-v1,能够自动识别并隐藏文本中的敏感信息,操作简单,支持英文(需微调支持其他语言),提供无需训练数据的微调工具,便于用户保护隐私。

https://fxtwitter.com/karminski3/status/2003996015943471501

https://fxtwitter.com/karminski3/status/2003996015943471501

InterceptSuite/ProxyBridge - 将 Windows/macOS 的 TCP/UDP 流量重定向到 HTTP/SOCKS5 代理

https://github.com/InterceptSuite/ProxyBridge

ProxyBridge 是一个轻量级的开源代理客户端,为 Windows 和 macOS 提供透明代理路由功能。

它能将特定进程的 TCP 和 UDP 流量重定向到 SOCKS5 或 HTTP 代理,支持基于应用程序的流量路由、阻止或允许,是 Proxifier 的替代方案。

● 跨平台支持(Windows 和 macOS)

● 双界面设计(GUI 和 CLI)

● 基于进程的流量控制(路由、阻止、允许)

● 支持多种代理协议(SOCKS5 和 HTTP)

● 系统级数据包拦截(内核 / 网络扩展级别)

● TCP 和 UDP 协议支持

● 流量阻止功能

● 灵活的规则配置(支持 IP、端口、协议、主机名等)

● 规则导入 / 导出功能

#Network #Tool #GitHub

https://github.com/InterceptSuite/ProxyBridge

ProxyBridge 是一个轻量级的开源代理客户端,为 Windows 和 macOS 提供透明代理路由功能。

它能将特定进程的 TCP 和 UDP 流量重定向到 SOCKS5 或 HTTP 代理,支持基于应用程序的流量路由、阻止或允许,是 Proxifier 的替代方案。

● 跨平台支持(Windows 和 macOS)

● 双界面设计(GUI 和 CLI)

● 基于进程的流量控制(路由、阻止、允许)

● 支持多种代理协议(SOCKS5 和 HTTP)

● 系统级数据包拦截(内核 / 网络扩展级别)

● TCP 和 UDP 协议支持

● 流量阻止功能

● 灵活的规则配置(支持 IP、端口、协议、主机名等)

● 规则导入 / 导出功能

#Network #Tool #GitHub

SteamTools

免费玩正版 Steam 游戏,可入库解锁 99% 的单机游戏,具体介绍和教程可以看 这篇文章 ,因为有云存档功能,所以也可以先上车后补票,小白慎用,上手略有难度,完全免费。

https://www.steamtools.net/

频道 @Edgebyte

Kerkerker 支持从 Dailymotion 获取资源,并可以自动匹配豆瓣电影信息

📮投稿 📢频道 💬群聊

KVideo 采用「Liquid Glass」设计语言,提供流畅的视觉体验和强大的视频搜索功能。

支持多源并行搜索、豆瓣数据展示、管理观看记录等功能

📮投稿 📢频道 💬群聊